Anthropic fecha acordo com SpaceX e turbina o Claude com mais de 220 mil GPUs

A Anthropic anunciou em 6 de maio de 2026 uma das movimentações mais importantes da nova corrida por inteligência artificial: uma expansão de capacidade computacional para o Claude, apoiada por um acordo com a SpaceX. A notícia não fala apenas de mais servidores. Ela mostra que a disputa entre empresas de IA passou a depender de chips, energia, data centers e acesso a infraestrutura física em escala gigantesca.

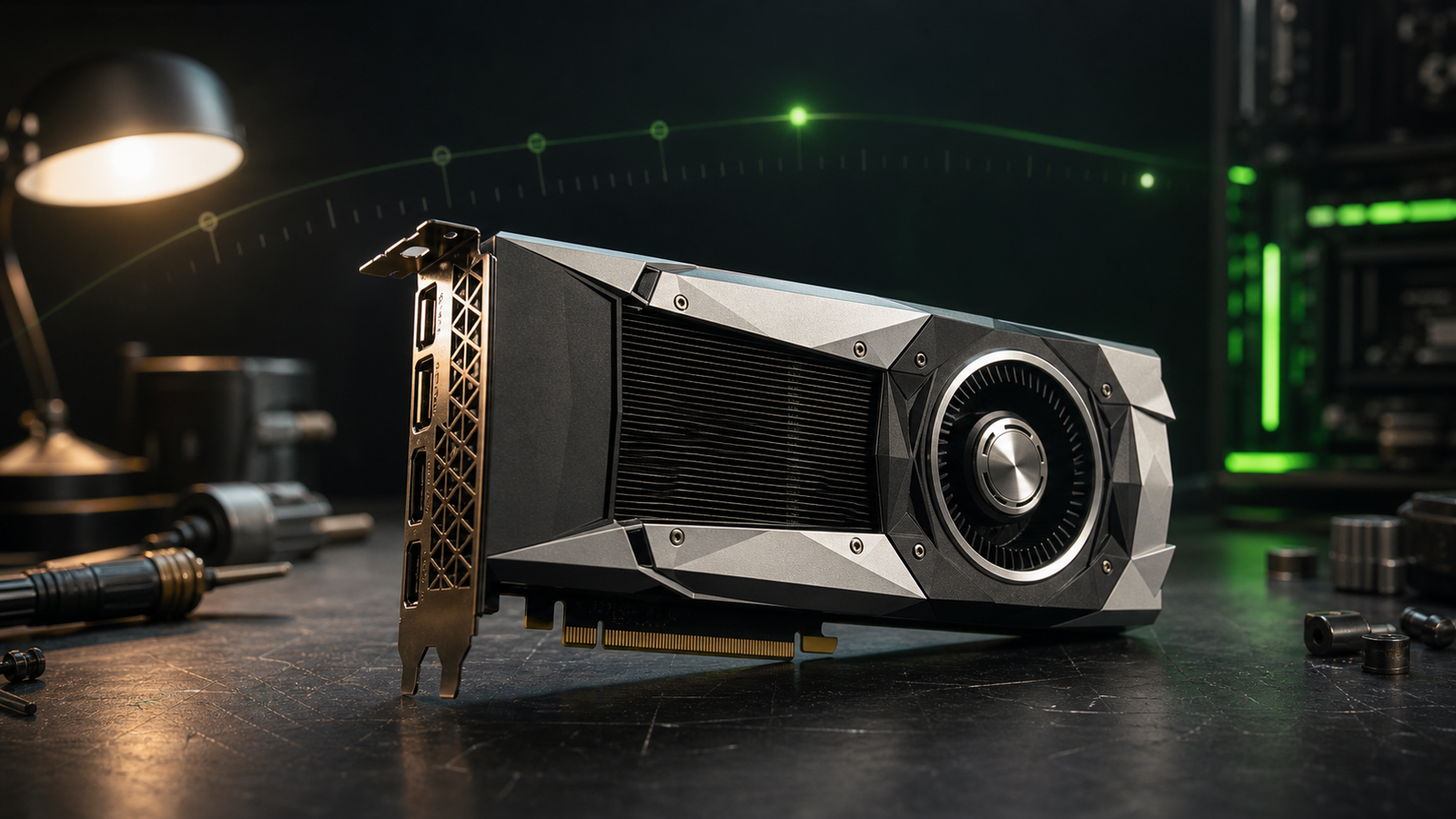

Segundo a empresa, o acordo permitirá usar a capacidade computacional do data center Colossus 1, associado à SpaceX, com mais de 300 megawatts de nova capacidade e mais de 220 mil GPUs NVIDIA. Na prática, isso já se traduz em limites maiores para o Claude Code e para a API dos modelos Claude Opus.

Resumo rápido

- A Anthropic dobrou os limites de cinco horas do Claude Code para planos Pro, Max, Team e Enterprise por assento.

- A redução de limite em horários de pico foi removida para usuários Pro e Max.

- Os limites da API para modelos Claude Opus foram aumentados.

- A empresa fechou acordo para usar a capacidade do data center Colossus 1.

- A estrutura inclui mais de 300 megawatts de nova capacidade e mais de 220 mil GPUs NVIDIA.

- A Anthropic também demonstrou interesse em explorar computação orbital de IA no futuro.

O que mudou para os usuários do Claude

A mudança mais imediata aparece no Claude Code, ferramenta voltada principalmente para programação, análise de código, automação e desenvolvimento assistido por IA. A Anthropic afirma que dobrou os limites de uso em janelas de cinco horas para usuários dos planos Pro, Max, Team e Enterprise por assento.

Isso é especialmente relevante para desenvolvedores que usam o Claude Code em sessões longas, como refatoração de projetos, revisão de código, criação de scripts, documentação técnica ou depuração. Antes, bater no limite no meio de uma tarefa podia quebrar o ritmo do trabalho. Com limites maiores, a expectativa é que a experiência fique menos interrompida.

Outro ponto importante é a remoção da redução de limites em horários de pico para usuários Pro e Max. Em serviços de IA, horários de alta demanda costumam gerar restrições adicionais. Ao retirar essa camada de limitação, a Anthropic tenta tornar o uso do Claude Code mais previsível para quem paga pelos planos individuais mais usados por profissionais.

A API também foi beneficiada. A empresa informou que aumentou os limites para modelos Claude Opus, o que deve ajudar equipes que usam Claude em aplicações próprias, fluxos internos, atendimento, análise de documentos, agentes de IA e produtos comerciais.

O acordo com a SpaceX

O centro do anúncio é o acordo de computação com a SpaceX. A Anthropic diz que assinou um contrato para usar toda a capacidade computacional do data center Colossus 1. A capacidade deve entrar em operação dentro do mês e terá impacto direto para assinantes Claude Pro e Claude Max.

Os números ajudam a dimensionar o movimento: mais de 300 megawatts de nova capacidade e mais de 220 mil GPUs NVIDIA. A xAI, em sua própria nota sobre a parceria, descreve o Colossus 1 como um dos maiores supercomputadores de IA já implantados rapidamente, com GPUs H100, H200 e GB200 em alta densidade.

Por que isso importa?

Porque a IA generativa não depende apenas de bons algoritmos. Ela também depende de uma quantidade enorme de computação para treinar modelos, atender usuários e responder chamadas de API em escala global.

Quando milhões de pessoas pedem respostas, escrevem código, analisam arquivos ou executam agentes de IA ao mesmo tempo, cada interação consome processamento. Quanto mais usuários pagantes e empresas dependem do Claude, maior é a pressão sobre a infraestrutura por trás do produto.

Por isso, aumentar capacidade não é só uma melhoria técnica. É uma vantagem competitiva. Mais GPUs e mais energia podem significar menos filas, limites maiores, melhor estabilidade e espaço para modelos mais avançados.

A corrida global por infraestrutura de IA

Anthropic, OpenAI, Google, Microsoft, Amazon e Meta competem por modelos melhores, mas também por infraestrutura física. A nova disputa da IA passa por data centers, contratos de nuvem, chips especializados, redes de alta velocidade, resfriamento e energia elétrica.

As GPUs viraram recurso estratégico. Empresas precisam comprar ou acessar milhares de aceleradores, instalar esses equipamentos, conectá-los e mantê-los operando. Ao mesmo tempo, a energia elétrica se tornou gargalo. Data centers de IA consomem volumes enormes de eletricidade, o que coloca pressão sobre redes locais e exige planejamento de longo prazo.

Esse contexto explica por que acordos de computação se tornaram tão relevantes quanto anúncios de novos modelos. Sem capacidade suficiente, até o melhor modelo pode virar um produto frustrante, cheio de filas, limites e indisponibilidade.

O lado curioso da parceria

A parceria tem um detalhe curioso: a SpaceX é associada a Elon Musk, que também está ligado à xAI, empresa por trás do Grok e concorrente direta de outras companhias de IA, incluindo a Anthropic.

Isso não torna o acordo contraditório por si só. Em tecnologia, empresas podem competir em um mercado e fazer negócios em outro. A Anthropic precisa de computação. A estrutura ligada à SpaceX tem capacidade para vender ou disponibilizar. Nesse cenário, a oportunidade comercial fala alto mesmo em um setor competitivo.

IA em órbita: o ponto mais futurista

A parte mais futurista do anúncio está na menção ao interesse da Anthropic em explorar, junto com a SpaceX, capacidade de computação orbital de IA em escala de gigawatts.

Em termos simples, isso aponta para a possibilidade de usar infraestrutura no espaço para computação de IA no futuro. Ainda não é algo garantido, nem deve ser tratado como produto pronto. Mas a ideia mostra como a demanda por IA está empurrando limites de energia, resfriamento e espaço físico.

Análise crítica

Para usuários do Claude, o impacto mais imediato deve ser menos frustração com limites, especialmente no Claude Code. Para desenvolvedores, isso pode significar jornadas de trabalho mais longas com o assistente, menos pausas forçadas e maior viabilidade para tarefas complexas.

Para empresas, limites maiores de API e mais capacidade operacional ajudam a criar confiança na adoção do Claude em escala. Em ambientes corporativos, previsibilidade muitas vezes vale tanto quanto inteligência do modelo.

Mas há um ponto de atenção. A IA está ficando cada vez mais dependente de infraestrutura extremamente cara. Isso pode concentrar poder em poucas empresas capazes de pagar por chips, energia e data centers gigantescos. Também amplia a disputa por eletricidade e por cadeias de suprimento de semicondutores.

A mensagem de fundo é clara: a disputa por energia e GPUs pode se tornar tão importante quanto a disputa por algoritmos.

Prompts de imagem sugeridos

- Data center futurista de inteligência artificial com milhares de racks de GPUs NVIDIA, luzes azuis, cabos de fibra óptica e um foguete da SpaceX ao fundo, estilo cinematográfico tecnológico, alta definição.

- Ilustração futurista mostrando um cérebro digital conectado a satélites em órbita e a um grande data center na Terra, tema inteligência artificial e computação espacial, cores azul e prata.

- Desenvolvedor usando Claude Code em múltiplos monitores, com visual de data center e GPUs ao fundo, estilo editorial para blog de tecnologia.

- Infraestrutura de IA em escala global, data centers, linhas de energia, chips NVIDIA e foguete subindo ao espaço, composição moderna e limpa.

Conclusão

A parceria entre Anthropic e SpaceX mostra uma nova fase da inteligência artificial. Vencer nesse mercado não depende apenas de ter o modelo mais avançado, mas de conseguir alimentar, resfriar e operar estruturas gigantescas de computação.

Com mais de 220 mil GPUs NVIDIA e mais de 300 megawatts de nova capacidade no Colossus 1, a Anthropic tenta transformar infraestrutura em vantagem competitiva: mais limites, mais estabilidade e mais escala para usuários e empresas.

A corrida da IA entrou de vez no mundo físico. O futuro dos modelos será decidido tanto por software quanto por chips, energia, cabos, data centers e, talvez um dia, infraestrutura em órbita.

Imagem de destaque sugerida: ilustração futurista de um data center massivo com racks de GPUs, energia azul e um foguete ao fundo, representando a ligação entre IA e infraestrutura espacial.

Fonte: notícia oficial da Anthropic, Higher usage limits for Claude and a compute deal with SpaceX, publicada em 6 de maio de 2026. Informações complementares sobre o Colossus 1 também foram conferidas na nota da xAI.

Publicar comentário